La compañía Google ha presentado Gemini Robotics-ER 1.6, una nueva versión de su modelo de razonamiento para robótica orientado a tareas en entornos físicos. La compañía señala que esta actualización mejora el razonamiento espacial, la comprensión multivista y la detección del éxito de una tarea, además de incorporar una nueva capacidad de lectura de instrumentos industriales.

El modelo está disponible para desarrolladores a través de la Gemini API y Google AI Studio. Según la información difundida por la empresa, Gemini Robotics-ER 1.6 puede actuar como sistema de razonamiento de alto nivel para un robot y ejecutar tareas mediante el uso nativo de herramientas como Google Search, modelos de visión-lenguaje-acción (VLA) y otras funciones definidas por terceros.

Mejoras en razonamiento espacial, multivista y lectura de instrumentos

Google asegura que Gemini Robotics-ER 1.6 supera tanto a Gemini Robotics-ER 1.5 como a Gemini 3.0 Flash en capacidades de razonamiento físico y espacial, especialmente en funciones como señalar objetos, contar elementos y determinar si una tarea se ha completado correctamente. La compañía precisa además que las pruebas de lectura de instrumentos se realizaron con agentic vision activado, salvo en Gemini Robotics-ER 1.5, que no es compatible con esa función.

Entre las capacidades destacadas figura el uso de puntos como paso intermedio para resolver tareas más complejas. Ese mecanismo permite, por ejemplo, localizar objetos con precisión, contarlos, establecer relaciones espaciales, definir trayectorias o comprobar restricciones. En uno de los ejemplos descritos, el modelo identificó correctamente 2 martillos, 1 tijera, 1 brocha, 6 alicates y un conjunto de herramientas de jardinería, y evitó señalar objetos inexistentes en la imagen, como una carretilla o un taladro Ryobi.

Aplicación en autonomía robótica e inspección industrial

La detección del éxito de una tarea es otro de los ámbitos reforzados en esta versión. Google indica que el sistema mejora el razonamiento con múltiples vistas de cámara, una capacidad relevante en configuraciones robóticas que combinan, por ejemplo, cámaras cenitales y cámaras montadas en la muñeca del robot. En el caso expuesto por la empresa, el modelo utiliza varias fuentes de vídeo para decidir cuándo se ha completado la acción de introducir un bolígrafo azul en un portalápices negro.

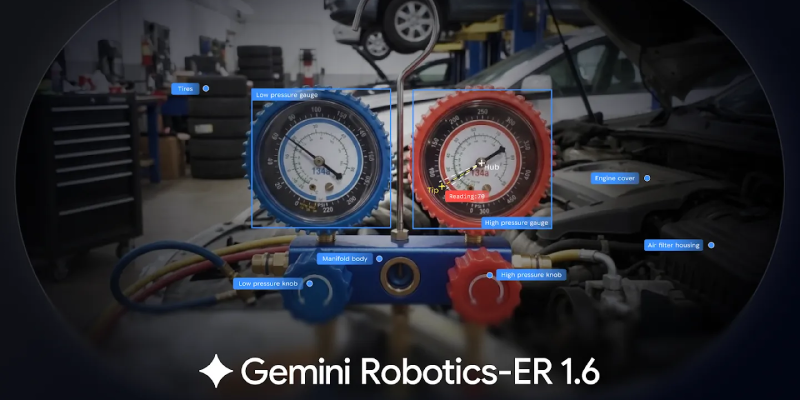

La nueva función de lectura de instrumentos surge, según la compañía, de su colaboración con Boston Dynamics y de necesidades asociadas a la inspección de instalaciones. En ese contexto, robots como Spot pueden recorrer una planta y capturar imágenes de termómetros, manómetros, visores de nivel y pantallas digitales. Google afirma que Gemini Robotics-ER 1.6 puede interpretar manómetros circulares, indicadores verticales de nivel y lecturas digitales modernas.

La lectura de estos equipos exige identificar con precisión agujas, niveles de líquido, límites de recipientes, marcas de escala y texto asociado a unidades de medida. En algunos casos también requiere combinar varias agujas correspondientes a distintos decimales o estimar niveles teniendo en cuenta distorsiones de perspectiva. Para ello, el modelo emplea agentic vision, una técnica que combina razonamiento visual y ejecución de código, con pasos intermedios como ampliación de imagen, señalamiento de referencias y estimación de proporciones e intervalos.

Seguridad y acceso para desarrolladores

Google sostiene que Gemini Robotics-ER 1.6 es su modelo de robótica más seguro hasta la fecha. Según los datos comunicados, mejora el cumplimiento de las políticas de seguridad de Gemini en tareas adversariales de razonamiento espacial y también muestra una mayor capacidad para respetar restricciones físicas, como no manipular líquidos o no recoger objetos de más de 20 kilogramos.

La empresa añade que, en pruebas sobre identificación de riesgos de lesión en escenarios de texto y vídeo basados en partes reales de accidentes, los modelos Gemini Robotics-ER obtienen mejores resultados que Gemini 3.0 Flash, con incrementos del 6% en texto y del 10% en vídeo. Junto con el lanzamiento, Google ha publicado un Colab para desarrolladores con ejemplos de configuración y uso del modelo en tareas de razonamiento embodied y ha invitado a la comunidad a remitir entre 10 y 50 imágenes etiquetadas de fallos específicos para mejorar futuras versiones.