Investigadores del Instituto de Tecnología de Massachusetts (MIT) han desarrollado una pulsera de ultrasonidos capaz de seguir en tiempo real los movimientos de la mano y traducirlos en órdenes para una mano robótica o para entornos de realidad virtual y aumentada. El sistema combina imágenes por ultrasonidos de músculos, tendones y ligamentos de la muñeca con un algoritmo de inteligencia artificial que interpreta la posición de los cinco dedos y la palma.

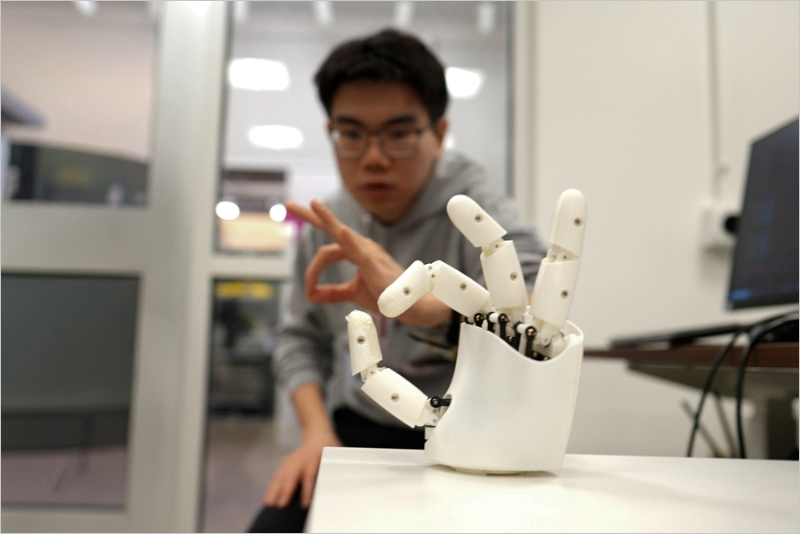

El dispositivo permite aprender los movimientos de la mano de cada usuario y transmitirlos de forma inalámbrica. En las pruebas realizadas, una persona equipada con la pulsera pudo controlar una mano robótica que replicaba sus gestos al instante, además de manipular objetos en una pantalla de ordenador mediante acciones como pellizcar con los dedos para ampliar o reducir un elemento virtual.

Avances en robótica

El trabajo publicado en Nature Electronics está firmado por Xuanhe Zhao, Gengxi Lu y otros investigadores del MIT, junto con colaboradores de la University of Southern California. Entre los autores figuran Xiaoyu Chen, Shucong Li, Bolei Deng, SeongHyeon Kim, Dian Li, Shu Wang, Runze Li, Anantha Chandrakasan, Yushun Zheng, Junhang Zhang, Baoqiang Liu, Chen Gong y Qifa Zhou.

La investigación aborda una dificultad conocida en robótica y realidad virtual: reproducir la destreza de la mano humana, cuyo funcionamiento implica la coordinación de 34 músculos, 27 articulaciones y más de 100 tendones y ligamentos. Frente a otras soluciones, como cámaras externas, guantes con sensores o sistemas basados en señales eléctricas musculares, el equipo optó por la imagen por ultrasonidos para captar movimientos más continuos y sutiles.

Pulsera de ultrasonido

La pulsera incorpora un adhesivo ultrasónico del tamaño de un reloj inteligente y electrónica integrada de un tamaño similar al de un teléfono móvil. Según los ensayos iniciales, el sistema genera imágenes continuas y nítidas de la muñeca mientras el usuario mueve los dedos con distintos gestos.

El principal reto fue relacionar las imágenes en blanco y negro obtenidas por ultrasonidos con posiciones concretas de la mano. Los investigadores identificaron regiones específicas de la muñeca que se corresponden con 22 grados de libertad del pulgar y los dedos, es decir, distintas formas de extensión y angulación. Para etiquetar esas correspondencias, un voluntario realizaba varias posiciones de la mano mientras varias cámaras registraban simultáneamente los gestos.

Con esos datos, el equipo entrenó un algoritmo de inteligencia artificial para reconocer patrones en las imágenes y asociarlos a cada grado de libertad. Posteriormente, el modelo se probó con nuevas imágenes de ultrasonidos y logró predecir correctamente los gestos correspondientes.

En la nueva fase del estudio participaron ocho voluntarios con diferentes tamaños de mano y muñeca. Todos llevaron la pulsera mientras realizaban distintos agarres y gestos, incluidas las 26 letras del alfabeto en lengua de signos estadounidense. También sostuvieron una pelota de tenis, una botella de plástico, unas tijeras y un lápiz. En todos los casos, el sistema siguió y predijo con precisión la posición de la mano.

Demostraciones prácticas

Para demostrar sus posibles usos, los investigadores conectaron de forma inalámbrica la pulsera a un programa informático sencillo. Así, los gestos de pellizco y agarre se traducían en acciones como ampliar, reducir, mover y manipular objetos virtuales de forma fluida y continua en la pantalla.

El equipo también la empleó como controlador inalámbrico de una mano robótica comercial. En una prueba, un voluntario imitó los movimientos de tocar un teclado y el robot reprodujo esos gestos en tiempo real para interpretar una melodía simple en un piano. En otra, la misma mano robótica replicó golpecitos con los dedos para jugar a un minibaloncesto de sobremesa.

Los investigadores están recopilando ahora más datos de movimiento de usuarios con distintas formas y tamaños de mano para construir un conjunto amplio de información útil en el entrenamiento de robots humanoides en tareas de destreza, incluidas posibles aplicaciones quirúrgicas. El grupo prevé además miniaturizar el hardware y ampliar el entrenamiento del software con más gestos y movimientos. El proyecto ha recibido apoyo, entre otros, del MIT, los National Institutes of Health, la National Science Foundation, el Department of Defense de Estados Unidos y la Singapore National Research Foundation a través de la Singapore-MIT Alliance for Research and Technology.